近日,信息学院贲晛烨教授团队联合复旦大学张军平教授、中科院心理所王甦菁副研究员、法国雷恩国立应用科学学院Kidiyo Kpalma教授、哈尔滨工业大学孟维晓教授和清华大学刘永进教授在国际顶级期刊IEEE Transactions on Pattern Analysis and Machine Intelligence上在线发表题为“Video-based Facial Micro-Expression Analysis: A Survey of Datasets, Features and Algorithms”的综述文章。伟德BETVLCTOR1946作为第一单位,信息学院贲晛烨教授为第一作者,刘永进教授和王甦菁副研究员为共同通讯作者。IEEE T-PAMI是计算机视觉与模式识别领域的顶尖期刊,是中国计算机学会(CCF)推荐的人工智能领域A类期刊,2019年的影响因子为17.861。

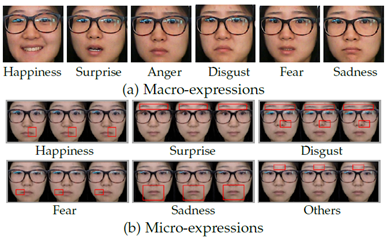

微表情不同于传统的面部表情,它是一种自发的、短暂的面部表情,能够揭示人们试图隐藏的真实情感。因此,微表情可以对诸多应用提供重要的信息,例如:测谎,刑事侦查等。微表情的短暂的和低强度等特点导致微表情的检测和识别非常困难,并且严重依赖于专家经验。由于微表情内在的特殊性和复杂性,基于视频的微表情分析是极具挑战性的研究领域。现有的微表情数据库大多数在诱发范式、标记方法或数据量小等方面存在不足;微表情研究领域尚没有一个全面的综述为研究者提供系统的概述和统一的评价。针对这些问题,该论文提供了一个全面的综述,重点聚焦在微表情检测和识别相关的计算算法,以及用于构建自动检测与识别系统的图像和视频特征。该论文还对最新的微表情数据集进行了详细的总结,在此基础上,对具有代表性的微表情识别方法进行了统一的公平比较。基于对现有数据集研究的局限性,该论文提出并发布了一个新的数据集,称为微表情-宏表情仓库(Micro-and-macro expression warehouse, MMEW),它包含从同一个体采集的宏表情和微表情。这个数据库是迄今为止最大规模的微表情数据库;它可以启发未来的研究,探索同一个体的宏表情和微表情之间的关系。

本论文研究工作得到了国家重点研发计划和山东省重大科技创新工程等项目的资助。

贲晛烨教授团队长期致力跨模态图像识别的研究,发现了多视角基特征,建立了跨视角共同表示学习模型,提高了跨视角学习匹配能力;提出了鉴别和鲁棒特征表达学习方法,降低了计算复杂度;提出了异质特征数据迁移学习方法,提高了识别性能以及视频重建的质量。在IEEE T-PAMI、IEEE T-IP、IEEE T-CSVT、IEEE T-MM、PR、CVPR等国内外核心期刊会议上发表学术论文96篇,1篇入选ESI高被引论文,被评为2019年《中国图象图形学报》新媒体高关注度作者。申请国家发明专利75项,授权42项,转让1项,成果在银川监狱、呼和浩特第三监狱和赣州监狱的个人谈话、心理矫治与智能审讯系统上成功应用,为科学矫正提供了技术支撑,社会效益显著。

论文链接:https://ieeexplore.ieee.org/document/9382112